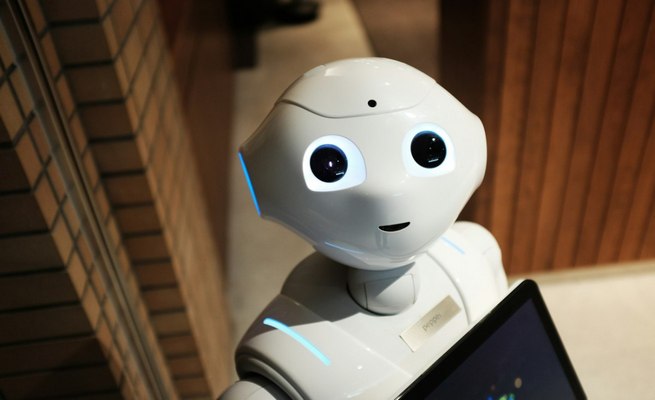

Η τεχνητή νοημοσύνη έχει διαφημιστεί ως ιδανικός βοηθός σε πολλούς τομείς της εργασίας. Ωστόσο, έρευνα Γάλλου νομικού απέδειξε ότι τα chatbots δεν είναι αλάνθαστα και η «ευκολία» έρχεται με προβλήματα

Όλο και περισσότεροι εργοδότες εντάσσουν προγράμματα με τεχνητή νοημοσύνη στις επιχειρήσεις τους και ζητούν εργαζόμενους που ξέρουν να τα χειριστούν. Στόχος, η ταχύτητα, η παραγωγικότητα και η αποδοτικότητα. Τα προγράμματα τεχνητής νοημοσύνης συντάσσουν εκθέσεις, κάνουν υπολογισμούς, βοηθούν τον χρήστη να παραγάγει ιδέες και κάνουν λογιστικές πράξεις. Είναι όλα αυτά σωστά; Τι γίνεται με τα δεδομένα μας;

Έρευνα του Νταμιάν Σαρλοτέν, νομικού, επιστήμονα δεδομένων και ανώτερου ερευνητή στη Σχολή Διοίκησης επιχειρήσεων HEC Paris, αποδεικνύει ότι η τεχνητή νοημοσύνη δεν είναι πανάκεια. Έχει πολλά πλεονεκτήματα, αλλά κάνει λάθη. Και όταν τα λάθη αφορούν νομικά έγγραφα και δίκες, τότε το πρόβλημα μπορεί να είναι πολύ σοβαρό.

Νομικά έγγραφα με «παραισθήσεις» – ψευδείς ή παραπλανητικές πληροφορίες

Στην έρευνά του διαπίστωσε ότι δικαστές σε όλο τον κόσμο αντιμετωπίζουν ένα αυξανόμενο πρόβλημα: νομικά έγγραφα που δημιουργήθηκαν με τη βοήθεια τεχνητής νοημοσύνης και υποβλήθηκαν με σφάλματα. Όπου σφάλματα είναι παραπομπές σε υποθέσεις που δεν υπάρχουν, σύμφωνα με δικηγόρους και δικαστικά έγγραφα.

Ο Νταμιάν Σαρλοτέν έχει καταγράψει τουλάχιστον 490 δικαστικά έγγραφα τους τελευταίους έξι μήνες που περιείχαν «παραισθήσεις». Δηλαδή, απαντήσεις από την τεχνητή νοημοσύνη που περιέχουν ψευδείς ή παραπλανητικές πληροφορίες. Και ο ρυθμός επιταχύνεται καθώς περισσότεροι άνθρωποι χρησιμοποιούν Τεχνητή Νοημοσύνη, λέει στο Associated Press.

«Ακόμα και ο πιο εξελιγμένος παίκτης μπορεί να έχει πρόβλημα με αυτό», σύμφωνα με τον Σαρλοτέν. «Η τεχνητή νοημοσύνη μπορεί να είναι δώρο. Είναι υπέροχη, αλλά υπάρχουν και οι παγίδες».

«Παραισθησιογόνο περιεχόμενο»

Έχοντας δημιουργήσει μια βάση δεδομένων, παρακολουθεί υποθέσεις στις δικαστές έκριναν ότι η τεχνητή νοημοσύνη παρήγαγε παραισθησιογόνο περιεχόμενο. Δηλαδή κατασκευασμένη νομολογία και ψευδή αποσπάσματα. Η πλειονότητα των αποφάσεων προέρχεται από υποθέσεις των ΗΠΑ στις οποίες οι ενάγοντες εκπροσωπήθηκαν χωρίς δικηγόρο. Έτσι, οι δικαστές είτε εξέδωσαν προειδοποιήσεις για τα λάθη είτε επέβαλαν πρόστιμα.

Αλλά προβληματικά, από νομική άποψη έγγραφα, έχουν υποβάλει ακόμη και μεγάλες εταιρείες, υψηλού προφίλ. Ομοσπονδιακός δικαστής στο Κολοράντο έκρινε ότι δικηγόρος της εταιρείας MyPillow Inc. υπέβαλε υπόμνημα που περιείχε σχεδόν 30 ελαττωματικές αναφορές στο πλαίσιο μιας υπόθεσης δυσφήμισης εναντίον της εταιρείας και του ιδρυτή της, Μάικλ Λίντελ.

Κινδυνεύουν εμπιστευτικές πληροφορίες

Ο Σαρλοτέν επισημαίνει ότι ακόμη και οι επισκοπήσεις της τεχνητής νοημοσύνης που εμφανίζονται στην κορυφή των αποτελεσμάτων αναζήτησης στο διαδίκτυο περιέχουν συχνά σφάλματα. Επίσης ότι τα εργαλεία αυτά μπορεί να θέτουν ζητήματα σχετικά με την προστασία της ιδιωτικής ζωής. Οι εργαζόμενοι σε όλους τους κλάδους πρέπει να είναι προσεκτικοί σχετικά με τις λεπτομέρειες που ανεβάζουν ή καταχωρούν σε μηνύματα, ώστε να διασφαλίζουν ότι προστατεύουν τις εμπιστευτικές πληροφορίες των εργοδοτών και των πελατών.

Τι να πρέπει να προσέχουμε

Νομικοί και ειδικοί στον χώρο εργασίας μοιράζονται τις εμπειρίες τους με τα λάθη της ΑΙ και περιγράφουν τους κινδύνους που πρέπει να αποφεύγονται.

-

Σκεφτείτε την τεχνητή νοημοσύνη ως βοηθό

Μην εμπιστεύεστε την τεχνητή νοημοσύνη να λαμβάνει μεγάλες αποφάσεις για εσάς. Ορισμένοι χρήστες αντιμετωπίζουν αυτό το εργαλείο ως ασκούμενο στον οποίο αναθέτουν εργασίες και του οποίου την ολοκληρωμένη εργασία περιμένουν να ελέγξουν.

Η Μαρία Φλιν, διευθύνουσα σύμβουλος της ΜΚΟ Jobs for the Future, που επικεντρώνεται στην ανάπτυξη των δεξιοτήτων του εργατικού δυναμικού, εξηγεί: «Σκεφτείτε την τεχνητή νοημοσύνη ως ενίσχυση της ροής εργασίας σας». Δηλαδή, σαν βοηθό για εργασίες όπως η σύνταξη ενός email ή η έρευνα ενός ταξιδιωτικού δρομολογίου. Αλλά δεν είναι το πλήρες υποκατάστατο εργαζομένου που μπορεί να κάνει όλη τη δουλειά.

Η Φλιν εξήγησε τι εννοούσε. Καθώς προετοιμαζόταν για μια συνάντηση, ζήτησε από εργαλείο τεχνητής νοημοσύνης να προτείνει ερωτήσεις συζήτησης με βάση ένα άρθρο που μοιράστηκε με την ομάδα.

«Ορισμένες από τις ερωτήσεις που πρότεινε δεν ήταν το σωστό πλαίσιο για τον οργανισμό μας. Όταν μπόρεσα να του δώσω κάποια από τα σχόλια… μου απάντησε με πέντε πολύ στοχαστικές ερωτήσεις», είπε.

-

Έλεγχος ακρίβειας

Η Μαρία Φλιν διαπίστωσε επίσης ότι το εργαλείο τεχνητής νοημοσύνης (βρίσκεται σε πιλοτικό στάδιο) δεν μπορούσε να ανταποκριθεί σε πιο σύνθετα προβλήματα. Όταν του ζήτησε να συγκεντρώσει πληροφορίες σχετικά με την εργασία που είχε κάνει ο οργανισμός της σε διάφορες πολιτείες, η τεχνητή νοημοσύνη αντιμετώπιζε την ολοκληρωμένη εργασία και τις προτάσεις χρηματοδότησης ως το ίδιο πράγμα.

«Σε αυτήν την περίπτωση, δεν ήταν σε θέση να εντοπίσει τη διαφορά ανάμεσα σε κάτι που είχε προταθεί και σε κάτι που είχε ολοκληρωθεί», είπε.

Ευτυχώς, είχε τις θεσμικές γνώσεις για να αναγνωρίσει τα λάθη. «Εάν είστε νέοι σε έναν οργανισμό, ρωτήστε τους συναδέλφους σας αν τα αποτελέσματα τους φαίνονται ακριβή», πρότεινε.

Συνεπώς, πρέπει να αφιερωθεί χρόνος στον έλεγχο αυτού που παράγει η τεχνητή νοημοσύνη. Ο Τζάστιν Ντάνιελς, δικηγόρος και μέτοχος μεγάλου γραφείου στην Ατλάντα, σημειώνει ότι «οι άνθρωποι κάνουν μια υπόθεση επειδή ακούγεται εύλογα ότι είναι σωστή και είναι βολική. Αν πρέπει να επιστρέψουν και να ελέγξουν όλες τις αναφορές ή, κοιτάζοντας μια σύμβαση που έχει συνοψίσει η Τεχνητή Νοημοσύνη, πρέπει να τη διαβάσουν, αυτό είναι λίγο άβολο και χρονοβόρο. Αλλά αυτό πρέπει να κάνουν. Όσο κι αν νομίζετε ότι η τεχνητή νοημοσύνη μπορεί να το κάνει για εσάς, δεν μπορεί».

-

Να είστε προσεκτικοί με τα προγράμματα σημειώσεων

Μπορεί να είναι δελεαστικό να χρησιμοποιείτε την τεχνητή νοημοσύνη για να καταγράφετε και να κρατάτε σημειώσεις κατά τη διάρκεια των συναντήσεων. Ορισμένα εργαλεία δημιουργούν χρήσιμες περιλήψεις και σκιαγραφούν βήματα δράσης με βάση αυτά που ειπώθηκαν.

Ωστόσο, πολλές δικαιοδοσίες απαιτούν τη συγκατάθεση των συμμετεχόντων πριν από την καταγραφή συνομιλιών. Πριν χρησιμοποιήσετε την τεχνητή νοημοσύνη για να κρατάτε σημειώσεις, σταματήστε και σκεφτείτε εάν η συνομιλία πρέπει να παραμείνει εμπιστευτική και εμπιστευτική.

Συμβουλευτείτε συναδέλφους στα νομικά ή τα τμήματα ανθρώπινου δυναμικού πριν χρησιμοποιήσετε ένα εργαλείο λήψης σημειώσεων σε καταστάσεις υψηλού κινδύνου, όπως έρευνες, αξιολογήσεις απόδοσης ή συζητήσεις νομικής στρατηγικής, λέει ο Ντάνιελ Κέις, επίσης δικηγόρος.

«Οι άνθρωποι ισχυρίζονται ότι με τη χρήση της Τεχνητής Νοημοσύνης θα πρέπει να υπάρχουν διάφορα επίπεδα συναίνεσης. Αυτό είναι κάτι που μπορεί να χρησιμοποιηθεί ως επιχείρημα στα δικαστήρια», επισήμανε.

-

Προστασία εμπιστευτικών πληροφοριών

Όσοι χρησιμοποιούν δωρεάν εργαλεία Τεχνητής Νοημοσύνης για να συντάξουν ένα υπόμνημα ή μια καμπάνια μάρκετινγκ, δεν πρέπει να του δίνουν πληροφορίες ταυτοποίησης ή εταιρικά μυστικά. Μόλις ανεβούν αυτές τις πληροφορίες, είναι πιθανό άλλοι που χρησιμοποιούν το ίδιο εργαλείο να τις βρουν. Ακόμη και αν δεν το επιδιώκουν.

Αυτό συμβαίνει επειδή όταν άλλοι άνθρωποι κάνουν ερωτήσεις σε ένα εργαλείο τεχνητής νοημοσύνης, αυτό θα αναζητήσει διαθέσιμες πληροφορίες, συμπεριλαμβανομένων λεπτομερειών που μπορεί να έχουν αποκαλυφθεί, για να φτιάξει την απάντησή του. Η τεχνητή νοημοσύνη «δεν διακρίνει αν κάτι είναι δημόσιο ή ιδιωτικό», επισημαίνει η Φλιν.

-

Εκπαιδευτείτε

Εάν ο εργοδότης σας δεν προσφέρει εκπαίδευση στην τεχνητή νοημοσύνη, δοκιμάστε να πειραματιστείτε με δωρεάν εργαλεία όπως το ChatGPT ή το Microsoft Copilot. Ορισμένα πανεπιστήμια και εταιρείες τεχνολογίας προσφέρουν μαθήματα που μπορούν να σας βοηθήσουν να κατανοήσετε πώς λειτουργεί η τεχνητή νοημοσύνη και πώς μπορεί να είναι χρήσιμη.

Παρά τα πιθανά προβλήματα με τα εργαλεία, η εκμάθηση του πώς λειτουργούν μπορεί να είναι ωφέλιμη σε μια εποχή που είναι πανταχού παρόντα.

«Η μεγαλύτερη πιθανή παγίδα στην εκμάθηση της χρήσης της τεχνητής νοημοσύνης είναι να μην μάθουμε καθόλου να τη χρησιμοποιούμε», λέει η Μαρία Φλιν. «Όλοι θα πρέπει να αποκτήσουμε πλήρη γνώση στην τεχνητή νοημοσύνη. Η εξοικείωση, η εκπαίδευση και η άνεση με το εργαλείο αυτό θα είναι εξαιρετικά σημαντική».

• Με στοιχεία από το Associated Press

ΠΗΓΗ in.gr